Israel. (Pablo Sanmartín Rodríguez).- Una investigación de la empresa de ciberseguridad Check Point Software Technologies ha encendido las alarmas en el ámbito tecnológico tras revelar una vulnerabilidad en el sistema de ChatGPT que habría permitido la extracción de datos sin generar advertencias visibles para los usuarios.

El hallazgo apunta al entorno de ejecución utilizado para tareas de análisis de datos basadas en Python, un espacio diseñado para operar de forma aislada. Según el informe, aunque el tráfico web tradicional se encontraba bloqueado, una función clave permanecía activa: el sistema de resolución de nombres de dominio (DNS), lo que abrió la puerta a un método de filtración conocido como “túnel DNS”.

Este mecanismo permite ocultar fragmentos de información dentro de solicitudes aparentemente normales, facilitando la transferencia encubierta de datos hacia servidores externos sin ser detectada por los sistemas de seguridad convencionales.

El riesgo no es menor si se considera la magnitud del uso de estas herramientas. OpenAI informó que, a finales de 2025, la plataforma superaba los 800 millones de usuarios semanales, quienes utilizan el sistema no solo para consultas básicas, sino también para procesar documentos sensibles, redactar contratos, analizar información financiera y comprender datos médicos.

Filtración silenciosa y alto impacto

De acuerdo con la investigación, el ataque podría iniciarse mediante instrucciones aparentemente inofensivas -conocidas como prompts- que los usuarios suelen copiar desde redes sociales o foros. Estas instrucciones podrían contener código malicioso capaz de activar el canal de filtración sin alterar el comportamiento visible del asistente.

El problema se agrava porque no solo se expondrían documentos originales, sino también los resúmenes generados por el propio modelo, considerados información de alto valor estratégico. Esto permitiría a un atacante obtener conclusiones clave sin necesidad de acceder a archivos completos.

Además, el riesgo se incrementa con el uso de asistentes personalizados, donde el comportamiento malicioso podría integrarse directamente en la configuración del sistema, dificultando aún más su detección por parte del usuario.

Respuesta y mitigación

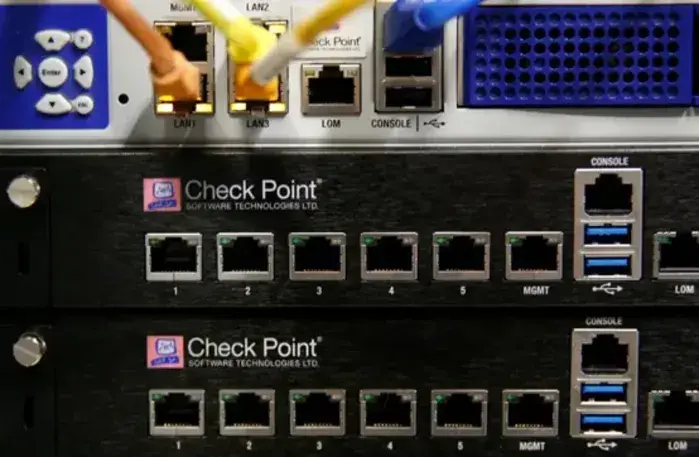

Check Point indicó que notificó el hallazgo a OpenAI, que confirmó haber identificado la vulnerabilidad y aplicado una solución completa el 20 de febrero de 2026. Aunque esta acción reduce el riesgo inmediato, expertos advierten que el incidente evidencia la necesidad de fortalecer los protocolos de seguridad en entornos de inteligencia artificial.

Un problema de confianza en la IA

El caso pone en evidencia un desafío creciente, la confianza en sistemas que ya no son simples herramientas, sino entornos de trabajo donde se procesa información altamente sensible.

Especialistas coinciden en que, si bien no es necesario abandonar el uso de estas tecnologías, sí resulta fundamental adoptar prácticas más prudentes al compartir datos, especialmente aquellos de carácter personal, financiero o profesional.

La evolución de la inteligencia artificial plantea así un nuevo paradigma, no solo importa la calidad de las respuestas, sino la seguridad de la infraestructura invisible que las hace posibles. (Contribuyó en la Traducción: Consulado General H. de Israel en Guayaquil. Fuente: The Jerusalem Post. Por Jacob Laznik)